· Tomasz Siroń · Historia

Odzyskiwanie danych po atakach na World Trade Center – technologia Blue Laser i lekcje dla współczesnego IT

Rocznica World Trade Center – jak technologia uratowała dane z gruzów

11 września 2001 roku ataki terrorystyczne na World Trade Center w Nowym Jorku zmieniły świat na zawsze. W tych chwilach wspominamy wszystkie ofiary oraz osoby, które poświęciły się, aby pomóc w odbudowie po tej katastrofie.

Ale wydarzenia 11 września miały również ogromny wpływ na branżę IT – wymusiły fundamentalną zmianę podejścia do bezpieczeństwa danych, planów disaster recovery i ciągłości działania biznesu. Historia odzyskiwania danych z ruin WTC to fascynujący przykład ludzkiej pomysłowości w obliczu pozornie niemożliwego wyzwania.

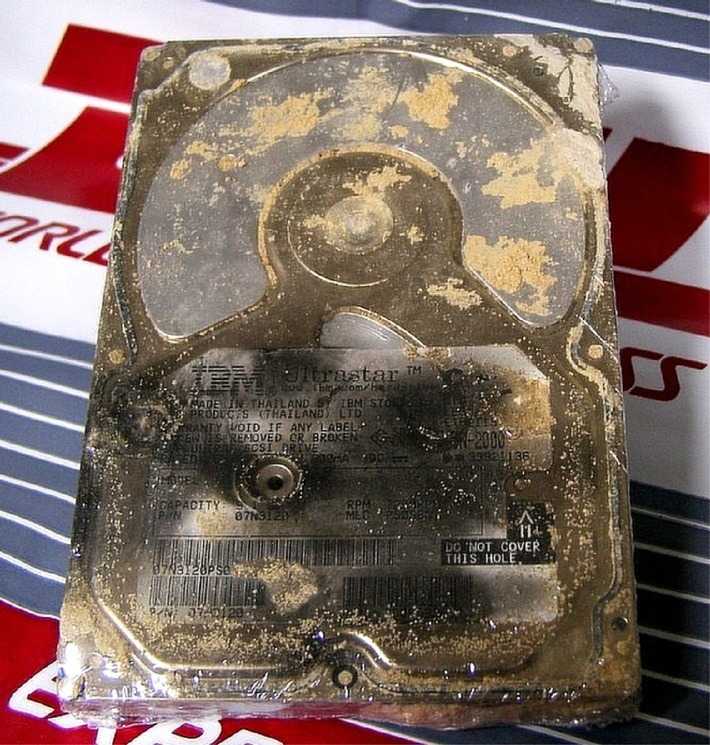

Dysk twardy IBM Ultrastar odnaleziony w ruinach World Trade Center. Mimo poważnych uszkodzeń fizycznych – korozji, deformacji obudowy i osadów – niemiecka firma CONVAR zdołała odczytać dane z talerzy magnetycznych za pomocą zaawansowanej technologii laserowej. Źródło: presseportal.de

Skala zniszczeń IT w World Trade Center

W World Trade Center mieściły się siedziby wielu największych instytucji finansowych świata. Kompleks 7 budynków był jednym z najważniejszych węzłów infrastruktury IT na Manhattanie:

- Cantor Fitzgerald – firma brokerska z siedzibą na piętrach 101–105 Wieży Północnej, która straciła 658 pracowników

- Morgan Stanley – zajmujący 22 piętra Wieży Południowej

- Deutsche Bank – biura w sąsiednim budynku, poważnie uszkodzone

- Salomon Smith Barney (Citigroup) – siedziba w WTC 7, który zawalił się po południu 11 września

- New York Board of Trade – piętra 8–9 WTC 4

Zniszczeniu uległy tysiące serwerów, macierzy dyskowych i stacji roboczych. Szacuje się, że w gruzach WTC znajdowało się ponad 400 000 dysków twardych i inne nośniki danych zawierające krytyczne informacje finansowe – rekordy transakcji, dane klientów, wewnętrzne dokumenty i systemy księgowe instytucji finansowych.

CONVAR i technologia Blue Laser Scanner

Firma CONVAR Deutschland GmbH

CONVAR Deutschland GmbH to niemiecka firma z siedzibby w Pirmasens (Nadrenia-Palatynat), specjalizująca się w odzyskiwaniu danych z uszkodzonych nośników. Po atakach na WTC firma otrzymała setki dysków twardych odnalezionych w ruinach – przypalonych, zdeformowanych, zalanych wodą i pokrytych gruzem betonowym.

Tradycyjne metody odzyskiwania danych – polegające na mechanicznym odczycie talerzy za pomocą głowic magnetycznych – były niemożliwe do zastosowania. Powierzchnie talerzy były zbyt uszkodzone, aby jakakolwiek głowica mogła się nad nimi unosić bez ryzyka dalszego zniszczenia danych.

Jak działa Blue Laser Scanner?

CONVAR opracował przełomową technologię Blue Laser Scanner, która pozwalała na odczytywanie danych z uszkodzonych talerzy dysków bez fizycznego kontaktu z powierzchnią:

-

Skanowanie laserem – precyzyjny promień lasera skanuje powierzchnię talerzy dysku punkt po punkcie

-

Analiza domen magnetycznych – talerze dysku twardego składają się z milionów mikroskopijnych domen magnetycznych. Każda domena jest namagnesowana w jednym z dwóch kierunków, reprezentując wartość binarną 0 lub 1

-

Efekt Kerra / Efekt Faradaya – namagnesowane domeny zmieniają właściwości optyczne światła laserowego (polaryzację), które jest od nich odbijane. Analiza tych zmian polaryzacji pozwala odczytać zapis magnetyczny

-

Rekonstrukcja danych – odczytane sygnały optyczne są przetwarzane przez specjalistyczne algorytmy, które rekonstruują oryginalną strukturę danych – sektory, klastry i system plików

Kluczową zaletą tej metody było to, że laser nie dotyka powierzchni talerza. W przypadku dysków z ruin WTC, gdzie talerze były pokryte pyłem, mikrodrobinami betonu i innymi zanieczyszczeniami, każdy fizyczny kontakt głowicy z powierzchnią talerza mógłby nieodwracalnie zniszczyć pozostałe dane.

Wyniki operacji odzyskiwania

Firma CONVAR odzyskała dane z wielu dysków – w tym kluczowe informacje finansowe, rekordy transakcji i dane, które były uznawane za nieodwracalnie utracone. Wśród odzyskanych danych znajdowały się zapisy transakcji o wartości setek milionów dolarów, co miało bezpośrednie znaczenie dla odtworzenia operacji finansowych i rozliczenia otwartych pozycji rynkowych.

Kontekst technologiczny – dyski twarde w 2001 roku vs dziś

Aby docenić skalę osiągnięcia CONVAR, warto przypomnieć, jak wyglądała technologia storage w 2001 roku:

| Parametr | Dyski HDD w 2001 roku | Nowoczesne nośniki (2025+) |

| Typowa pojemność (3,5") | 9,1 GB – 40 GB | 8 TB – 30 TB (HDD), 1–8 TB (SSD) |

| Gęstość zapisu | ~10–20 Gbit/in² | ~1000+ Gbit/in² (HDD), wielowarstwowe NAND (SSD) |

| Technologia zapisu | Longitudinal (podłużny) | PMR/SMR (prostopadły) w HDD, 3D NAND w SSD |

| Interfejs | IDE (PATA), wczesne SCSI | SATA III, NVMe, SAS |

| Prędkość obrotowa | 5400–10 000 RPM | 5400–15 000 RPM (HDD), brak (SSD) |

| Rozmiar domeny magnetycznej | Większy (~100 nm) | Mniejszy (~15–30 nm) |

| Podatność na fizyczne uszkodzenie | Wysoka (mechanika) | HDD: wysoka, SSD: niska (brak ruchomych części) |

Dlaczego Blue Laser Scanner nie zadziałaby na nowoczesnych dyskach?

Współczesne dyski twarde mają 50–100× większą gęstość zapisu niż dyski z 2001 roku. Domeny magnetyczne są tak małe, że:

- Wymagana rozdzielczość optyczna przekracza możliwości konwencjonalnych laserów

- Technologia PMR (Perpendicular Magnetic Recording) zapisuje dane prostopadle do powierzchni, co zmienia charakter interakcji z laserem

- Nowoczesne dyski używają technologii SMR (Shingled Magnetic Recording), gdzie ścieżki nachodzą na siebie

W przypadku dysków SSD technologia laserowa jest całkowicie bezużyteczna – dane są przechowywane w komórkach NAND Flash jako ładunki elektryczne, a nie domeny magnetyczne.

Dlatego współczesne podejście do odporności na katastrofy opiera się na prewencji (backup, replikacja, DR) zamiast na nadziei na odzyskanie danych z fizycznie uszkodzonych nośników.

Lekcje z 11 września dla współczesnego IT

Ataki na WTC stały się punktem zwrotnym w podejściu firm do ciągłości działania i odporności IT. Wiele praktyk, które dziś uważamy za oczywiste, zostało wdrożonych lub zintensyfikowanych właśnie po 11 września.

1. Geograficzna redundancja infrastruktury

Przed 11 września wiele instytucji finansowych miało swoje główne i zapasowe centra danych w tym samym kompleksie budynków lub w bliskiej odległości na Manhattanie. Katastrofa ujawniła, że zapasowe lokalizacje muszą być geograficznie oddalone od głównych – co najmniej kilkadziesiąt kilometrów, a najlepiej w innym regionie.

Dziś standardem są architektury multi-region i multi-AZ (Availability Zone) w chmurach publicznych, które automatycznie replikują dane między odległymi lokalizacjami.

2. Business Continuity Planning (BCP)

11 września udowodnił, że plan ciągłości działania musi uwzględniać scenariusze utraty całej lokalizacji – nie tylko pojedynczego serwera czy dysku. Firmy, które miały przetestowane plany BCP, wznowiły działalność w ciągu dni. Te, które nie miały – potrzebowały tygodni lub miesięcy.

Więcej o planowaniu ciągłości działania piszemy w artykule o Disaster Recovery Plan.

3. Reguła backupu 3-2-1 (i jej ewolucja)

Historia WTC to najdramatyczniejszy argument za regułą 3-2-1:

- 3 kopie danych

- 2 różne media (np. dysk + taśma lub dysk + chmura)

- 1 kopia poza siedzibą firmy (off-site)

W 2025+ reguła ewoluowała do 3-2-1-1-0:

- ...+ 1 kopia w trybie immutable (odporna na ransomware)

- ...+ 0 błędów weryfikacji (regularne testy odtwarzania)

O strategiach backupu w kontekście chmury piszemy w artykule o disaster recovery i backupie w chmurze wielochmurowej.

4. Regularne testy odtwarzania

Wiele firm w WTC miało kopie zapasowe – ale nikt nie testował, czy da się z nich odtworzyć systemy. To krytyczny błąd, który powtarza się do dziś. W SparkSome zawsze podkreślamy: backup, który nie został przetestowany, nie jest backupem.

5. Decentralizacja i chmura

Po 11 września nastąpiło przyspieszenie adopcji modeli rozproszonych i wirtualizacji. Dziś chmura obliczeniowa oferuje natywną replikację danych między regionami, co eliminuje ryzyko utraty wszystkich danych w jednym zdarzeniu katastroficznym.

6. Bezpieczeństwo fizyczne infrastruktury IT

Katastrofa WTC przypomniała, że bezpieczeństwo IT to nie tylko firewall i szyfrowanie – to również ochrona fizyczna serwerowni: systemy przeciwpożarowe, zasilanie awaryjne (UPS + generator), kontrola dostępu i monitoring środowiskowy (temperatura, wilgotność).

Co by się stało, gdyby WTC zawalił się w 2025 roku?

Hipotetyczny scenariusz pozwala ocenić, jak daleko zaszła branża IT od 2001 roku:

| Aspekt | Scenariusz 2001 | Hipotetyczny scenariusz 2025 |

| Lokalizacja danych | Głównie on-premise w WTC | Multi-region cloud (AWS, Azure), kolokacje poza Manhattan |

| Backup | Taśmy w pobliskiej lokalizacji | Replikacja real-time do oddalonych regionów, immutable backupy |

| Odzyskiwanie danych | Fizyczne wydobywanie dysków z ruin | Automatyczny failover na repliki w innym regionie |

| Czas odtworzenia (RTO) | Tygodnie–miesiące | Minuty–godziny (zależy od RPO/RTO) |

| Utrata danych (RPO) | Godziny–dni | Sekundy (synchroniczna replikacja) lub minuty (asynchroniczna) |

| Komunikacja wewnętrzna | Zniszczone centrale telefoniczne | Microsoft Teams, Slack, Zoom – dostępne z dowolnego urządzenia |

| Praca zdalna | Praktycznie niemożliwa | Standard – VPN, VDI, SaaS |

Oczywiście, żaden plan DR nie eliminuje tragicznego wymiaru klęsk – ludzi nie da się zreplikować. Ale odpowiednia strategia IT może zapewnić, że firma przetrwa operacyjnie nawet najgorszy scenariusz.

Jak SparkSome pomaga firmom przygotować się na katastrofy

W SparkSome pomagamy firmom budować odporną infrastrukturę IT na wypadek scenariuszy, które – jak 11 września – mogą wydawać się nieprawdopodobne, dopóki się nie zdarzą:

- Projektowanie architektury DR – z geograficzną redundancją i definiowaniem RPO/RTO. Więcej o tym jak zaprojektować infrastrukturę IT w firmie.

- Wdrażanie strategii backupu 3-2-1-1-0 – z automatyczną weryfikacją spójności

- Testy odtwarzania – regularne symulacje utraty danych i infrastruktury

- Dokumentacja techniczna – aby wiedza o systemach nie zginęła razem z kluczowymi osobami (bus factor)

- Disaster Recovery as a Service (DRaaS) – gotowe środowisko zapasowe, które można uruchomić w ciągu minut

Skontaktuj się z nami, aby ocenić odporność Twojej firmy na katastroficzne scenariusze.

Powiązane artykuły

- Disaster Recovery Plan – jak zabezpieczyć firmę przed awarią IT? — planowanie ciągłości działania

- Disaster Recovery – backup i chmura wielochmurowa — strategie replikacji danych

- Chmura czy własny serwer? — porównanie modeli przechowywania danych

- Ile kosztuje godzina przestoju IT? — finansowy wymiar awarii

- Jak bezpiecznie wycofać sprzęt IT z firmy? — niszczenie danych na wycofywanych nośnikach

- Awaria RAID – lekcja dla e-commerce — co się dzieje gdy macierz się rozpadnie

- Bus factor – odporność IT i dokumentacja wiedzy — gdy kluczowa osoba odejdzie

FAQ – Odzyskiwanie danych, disaster recovery i lekcje z WTC

1. Czy dane z dysków twardych z WTC udało się w pełni odzyskać?

Nie wszystkie. CONVAR Deutschland odzyskał dane z części dysków – głównie tych, które zachowały integralność talerzy magnetycznych. Dyski, których talerze były fizycznie połamane, wgięte lub stopione, były poza zasięgiem nawet technologii Blue Laser Scanner. Firma przetworzyła setki dysków, odzyskując m.in. rekordy transakcji finansowych o wartości setek milionów dolarów.

2. Czym jest Blue Laser Scanner firmy CONVAR?

Blue Laser Scanner to opatentowana technologia odczytywania danych z uszkodzonych talerzy dysków twardych bez fizycznego kontaktu. Wykorzystuje promień lasera do skanowania powierzchni talerza i analizę zmian polaryzacji światła odbitego od namagnesowanych domen (efekt magneto-optyczny Kerra). Pozwala to odczytać zapis magnetyczny nawet z talerzy pokrytych zanieczyszczeniami.

3. Czy technologię Blue Laser Scanner można zastosować na nowoczesnych dyskach HDD?

Praktycznie nie. Współczesne dyski mają 50–100× większą gęstość zapisu (domeny magnetyczne ~15–30 nm vs ~100 nm w 2001), co wymaga rozdzielczości optycznej przekraczającej możliwości konwencjonalnych laserów. Technologie PMR i SMR zmieniają też charakter zapisu, utrudniając odczyt optyczny.

4. Czy z dysków SSD też da się odzyskać dane po katastrofie?

To znacznie trudniejsze. Dyski SSD przechowują dane jako ładunki elektryczne w komórkach NAND Flash – nie jako domeny magnetyczne. Technologia laserowa jest bezużyteczna. Odzyskiwanie wymaga specjalistycznych technik elektroniczych na poziomie chipów NAND. Ponadto, wiele SSD stosuje szyfrowanie sprzętowe (SED), co bez klucza czyni dane nieodczytywalnymi nawet po fizycznym dostępie do chipów.

5. Co to jest reguła backupu 3-2-1?

Reguła 3-2-1 to podstawowa strategia ochrony danych: 3 kopie danych, na 2 różnych mediach (np. dysk + chmura), w tym 1 kopia poza siedzibą firmy (off-site). Współcześnie ewoluowała do 3-2-1-1-0: dodatkowa kopia w trybie immutable (niemodyfikowalna, odporna na ransomware) + 0 błędów weryfikacji (regularne testy odtwarzania).

6. Czym różni się RPO od RTO?

RPO (Recovery Point Objective) – ile danych mogę stracić? Definiuje maksymalny akceptowalny okres utraty danych (np. RPO = 1 godzina oznacza, że akceptujesz utratę zmian z ostatniej godziny). RTO (Recovery Time Objective) – jak szybko muszę wrócić do działania? Definiuje maksymalny czas przywracania systemów po awarii. Dla systemów krytycznych RPO i RTO mierzą się w minutach, a nie godzinach.

7. Jak 11 września wpłynął na regulacje dotyczące bezpieczeństwa danych?

Ataki na WTC przyspieszyły wdrożenie wielu regulacji: w USA wzmocniono wymagania HIPAA i SOX (Sarbanes-Oxley Act z 2002, wymagający audytu BCP w spółkach publicznych), regulatorzy finansowi (SEC, FINRA) narzucili wymogi geograficznej redundancji centrów danych. W Europie inspirowało to późniejsze prace nad RODO i dyrektywą NIS/NIS2.

8. Czy moja firma potrzebuje planu Disaster Recovery?

Tak – każda firma, niezależnie od wielkości. Pytanie nie brzmi „czy" dojdzie do awarii, ale „kiedy". Plan DR nie musi być skomplikowany – nawet prosty plan z regularnym backupem off-site i procedurą odtwarzania jest lepszy niż brak planu. Kluczowe jest przetestowanie planu, a nie tylko jego napisanie.

9. Ile kosztuje brak planu Disaster Recovery?

Według badań FEMA, 40% małych firm, które doświadczą poważnej katastrofy, nigdy nie wznowi działalności. Koszty obejmują: utratę danych, przestoje operacyjne, kary regulacyjne, utratę klientów i reputacji. Dla firm średniej wielkości godzina przestoju IT może kosztować od kilku do kilkudziesięciu tysięcy złotych. Szczegółowo analizujemy te koszty w artykule o kosztach przestoju IT.

10. Co to jest immutable backup i dlaczego jest ważny?

Immutable backup to kopia zapasowa, której nie da się zmodyfikować ani usunąć przez określony czas – nawet przez administratora. Chroni przed ransomware, które szyfruje lub kasuje backupy. Warto stosować w chmurze (np. AWS S3 Object Lock, Azure Immutable Blob Storage) lub na dedykowanych systemach NAS z funkcją WORM (Write Once, Read Many).

11. Czy chmura eliminuje ryzyko utraty danych w katastrofie?

Znacząco je zmniejsza, ale nie eliminuje. Chmura oferuje automatyczną replikację między regionami, ale Ty nadal odpowiadasz za: prawidłową konfigurację replikacji, polityki retencji, szyfrowanie danych i zarządzanie dostępem. Ponadto, ryzyko utraty danych w chmurze może wynikać z błędów konfiguracji, ataków ransomware lub przypadkowego usunięcia – a nie tylko z katastrof fizycznych.

12. Jak SparkSome pomaga w planowaniu disaster recovery?

SparkSome oferuje kompleksowe wsparcie: audyt obecnej strategii DR, definiowanie RPO/RTO dla krytycznych systemów, projektowanie architektury z geograficzną redundancją, wdrożenie systemów backupu z testami odtwarzania, dokumentację procedur i szkolenia zespołu IT. Pomagamy firmom średniej wielkości budować odporność IT klasy enterprise bez enterprise'owego budżetu.