· Tomasz Siroń · Technologia

Komunikacja radiowa – od pierwszej iskry do ery Wi‑Fi i 5G

Bezprzewodowa komunikacja jest dziś tak oczywista, że niemal przestaliśmy ją zauważać. A przecież za każdym połączeniem Wi-Fi, transmisją radiową czy rozmową telefoniczną stoi ponad sto lat odkryć, eksperymentów i inżynierskich przełomów. W tym artykule przyglądamy się, jak narodziło się radio, jak działają fale elektromagnetyczne i w jaki sposób ta sama fizyka doprowadziła nas do świata nowoczesnych sieci bezprzewodowych.

Kula plazmowa pokazuje, jak zmienne pola elektryczne i magnetyczne mogą oddziaływać z otoczeniem. Choć wygląda jak czysta magia, to ten sam rodzaj zjawiska – oscylujące pola elektromagnetyczne – leży u podstaw działania anten i fal radiowych.

Odkrycie fal radiowych – narodziny bezprzewodowej komunikacji

Historia komunikacji radiowej zaczyna się od przełomowych odkryć naukowych w XIX wieku. Już w 1864 roku szkocki fizyk James Clerk Maxwell teoretycznie przewidział istnienie fal elektromagnetycznych, jednak dopiero w 1887 roku udało się je zaobserwować doświadczalnie. Dokonał tego niemiecki fizyk Heinrich Hertz, wykazując istnienie fal radiowych za pomocą iskrzącego wyładowania elektrycznego i metalowej pętli odbiorczej. Tym samym potwierdził, że „promienie elektromagnetyczne” Maxwella rzeczywiście rozchodzą się w przestrzeni. Odkrycie to otworzyło drogę do bezprzewodowej komunikacji, choć sam Hertz początkowo nie dostrzegał praktycznych zastosowań swojego eksperymentu.

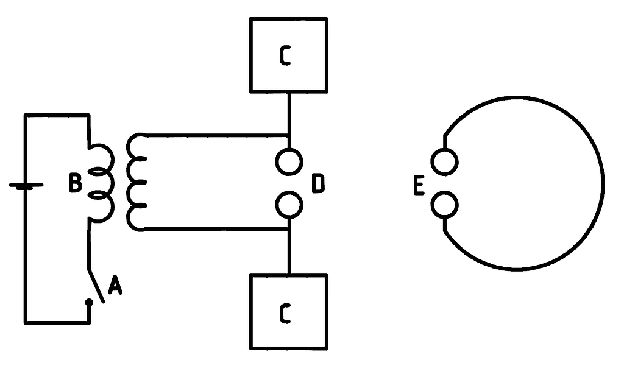

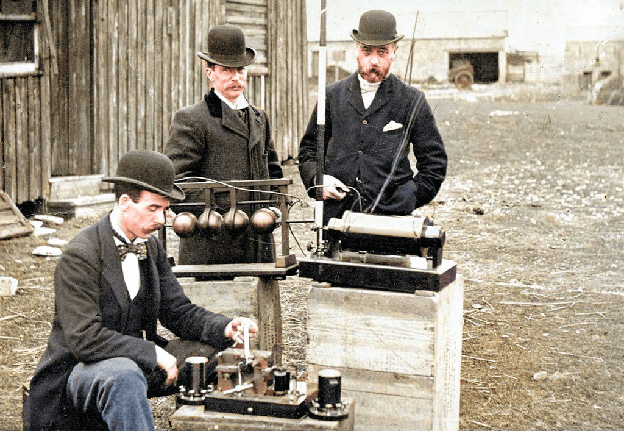

Schemat doświadczenia Heinricha Hertza (1887). Iskra w nadajniku wzbudza fale elektromagnetyczne, które indukują iskrę w pierścieniu odbiorczym.

Nad wykorzystaniem fal Hertza do przesyłania informacji pracowało wielu wynalazców – radio nie ma jednego „ojca”. Kluczowe okazały się prace Guglielmo Marconiego we Włoszech oraz Nikoli Tesli w Stanach Zjednoczonych. Marconi zbudował nadajnik i odbiornik, udoskonalił wynalazek tzw. koherera (detektora fal) i w 1894 roku uzyskał pierwsze połączenie radiowe na odległość kilku metrów. W kolejnych latach systematycznie zwiększał zasięg – w 1896 roku otrzymał brytyjski patent na telegraf bez drutu, a w 1899 przesłał sygnał radiowy przez kanał La Manche. Kulminacją tych wysiłków było dokonanie w grudniu 1901 roku – Marconi odebrał sygnał nadany z Europy w Ameryce Północnej, po raz pierwszy przekraczając Ocean Atlantycki. Co ciekawe, komunikat był niezwykle prosty: składał się z trzech krótkich sygnałów – kropek alfabetu Morse’a oznaczających literę S. Tak oto pierwszy transatlantycki telegram radiowy brzmiał po prostu „S”. Warto dodać, że równolegle swoje eksperymenty prowadził rosyjski fizyk Aleksander Popow, który już w 1895 roku skonstruował wykrywacz burz (pierwszy odbiornik radiowy z anteną) i niezależnie demonstrował możliwość odbioru sygnałów na odległość.

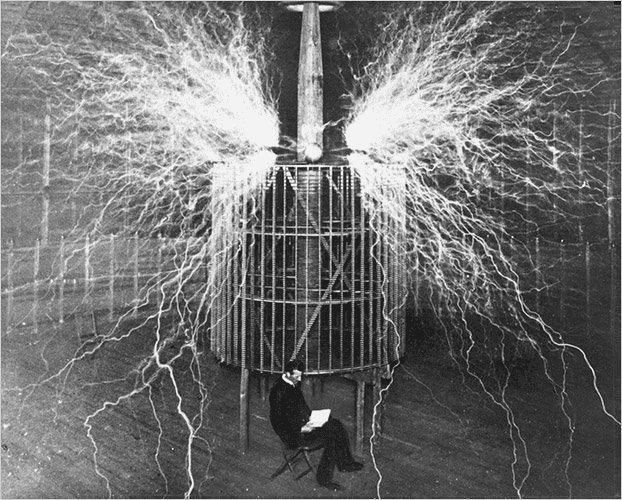

Jedno z najsłynniejszych zdjęć przedstawiających eksperyment z wysokim napięciem w laboratorium Tesli. Takie doświadczenia pomogły zrozumieć, że drgające prądy mogą wytwarzać fale radiowe zdolne do przenoszenia energii i informacji przez przestrzeń, fundament wszystkich późniejszych systemów transmisji radiowej.

Mimo tych sukcesów, nie wszyscy wierzyli w przyszłość nowej technologii.

Ciekawostka: w 1897 roku słynny fizyk lord William Thomson Kelvin stwierdził, że „radio nie ma żadnej przyszłości”. Jak wiemy dziś, mylił się spektakularnie, w ciągu następnych dekad radio znalazło niezliczone zastosowania. Już w 1903 roku Duńczyk Valdemar Poulsen wykorzystał fale radiowe do pierwszej transmisji ludzkiego głosu na odległość. Świat przekonał się o potędze radia także w sytuacjach kryzysowych, na przykład w 1912 roku załoga Titanica nadała drogą radiową sygnał SOS, wzywając pomocy dla tonącego statku. Wykorzystanie telegrafu bezprzewodowego odegrało ogromną rolę w akcjach ratunkowych i pokazało, jak radio może ratować życie na morzu. W 1906 roku miało miejsce inne doniosłe wydarzenie: 24 grudnia 1906 roku wyemitowano pierwszy w historii program radiowy, który obejmował muzykę (piosenkę i solo skrzypcowe), recytację wiersza i krótkie przemówienie. Jeśli chcesz poznać szerszy kontekst tego momentu, zobacz także tekst Wigilia 1906 – tam, gdzie technika stała się cudem. Nadawca tej świątecznej audycji, słyszalnej bez kabli, zademonstrował, że fale radiowe mogą przenosić nie tylko krótkie sygnały, ale całe spektakle dźwiękowe.

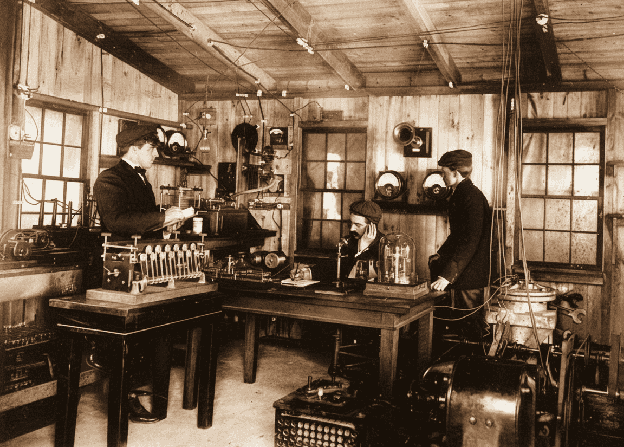

Laboratorium Reginalda Fessendena w Brant Rock (Massachusetts), gdzie 24 grudnia 1906 roku przeprowadził pierwszą w historii transmisję radiową z dźwiękiem ludzkiego głosu i muzyką. To wydarzenie zapoczątkowało erę radia, przekształcając fale elektromagnetyczne z narzędzia naukowego w środek masowej komunikacji.

Na początku lat 20. radio wkroczyło na scenę masową. Pierwsza publiczna rozgłośnia radiowa (KDKA) zaczęła nadawanie w Pittsburghu w 1920 roku, a w ślad za nią poszły kolejne stacje. Wkrótce odbiorniki radiowe stały się dostępne w sprzedaży i miliony ludzi zaczęły gromadzić się przed „szumofonami”, by słuchać muzyki czy wiadomości. Radio stało się pierwszym medium masowym na świecie, na długo przed telewizją i internetem. Nic dziwnego – dzięki transmisji na falach elektromagnetycznych komunikat radiowy dociera do odbiorców z prędkością światła, czyli niemal natychmiast. W ciągu zaledwie kilku dziesięcioleci technologia, w którą powątpiewano, połączyła ludzi na całym globie. Jeśli interesuje Cię szersze tło rozwoju infrastruktury przesyłu danych i sieci w Polsce, zobacz też tekst Infrastruktura cyfrowej Polski.

W skrócie:

- Radio narodziło się z eksperymentów naukowych Maxwella, Hertza, Tesli i Marconiego.

- Początkowo służyło głównie do przesyłania prostych sygnałów na odległość.

- Bardzo szybko stało się jednym z najważniejszych wynalazków komunikacyjnych XX wieku.

Jak powstaje fala radiowa? Podstawy fizyki i rola anteny

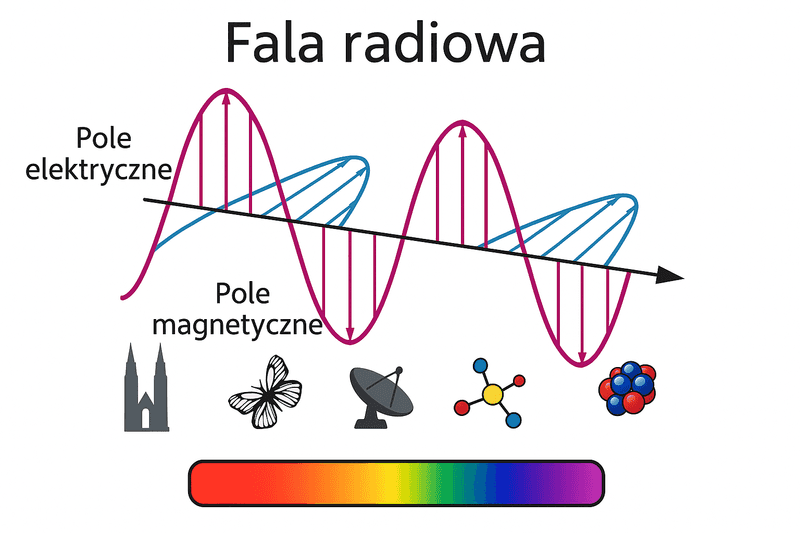

Aby zrozumieć, jak działa komunikacja radiowa, warto poznać podstawy fizyki fal elektromagnetycznych. Fale radiowe to nic innego jak rozchodzące się w przestrzeni zaburzenia pola elektromagnetycznego – zmienne pole elektryczne i zmienne pole magnetyczne, które wzajemnie się ze sobą powiązują. Mówiąc prościej, zmieniające się pole elektryczne wytwarza zmienne pole magnetyczne, a zmieniające się pole magnetyczne wytwarza zmienne pole elektryczne. Te dwie składowe nakręcają się nawzajem, tworząc falę, która może propagować w przestrzeni, nawet w próżni, z olbrzymią prędkością (równą prędkości światła, ~300 tys. km/s).

Fala elektromagnetyczna składa się z dwóch sprzężonych ze sobą pól: elektrycznego (E) i magnetycznego (B), które drgają prostopadle do siebie i do kierunku rozchodzenia się fali. To właśnie takie oscylacje niosą energię i informację w eterze, od radia i telewizji po Wi-Fi i 5G. Kolorowy pasek poniżej pokazuje całe spektrum elektromagnetyczne, od fal radiowych po promieniowanie widzialne i dalej, aż do ultrafioletu i promieniowania gamma.

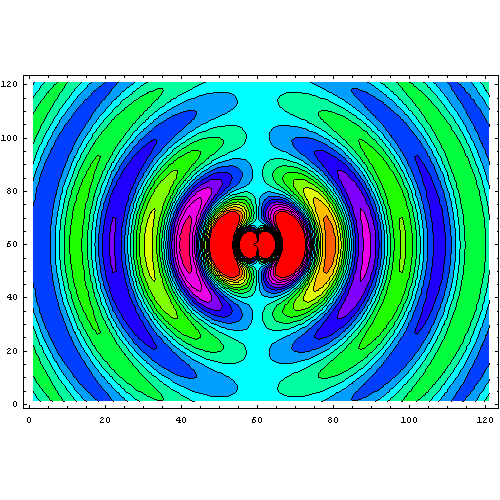

Jak wytworzyć taką falę? Trzeba rozkołysać ładunki elektryczne. Jeśli przez prosty przewodnik, na przykład kawałek drutu, puścimy prąd zmienny, to elektrony w tym drucie zaczną drgać tam i z powrotem. Drgające ładunki wytwarzają zmienne pola elektryczne i magnetyczne, a w otoczeniu przewodnika powstaje fala elektromagnetyczna, która „odrywa się” od anteny i biegnie w świat. Urządzenie, które emituje fale, nazywamy anteną nadawczą. Klasycznym przykładem jest prosty dipol – dwa kawałki metalowego pręta, do których doprowadza się sygnał elektryczny o wysokiej częstotliwości. W takim dipolu elektrony oscylują, a antena wypromieniowuje drgające pole elektromagnetyczne w przestrzeń.

Animacja fali elektromagnetycznej promieniowanej przez antenę dipolową

Skąd wiadomo, że fala faktycznie oderwie się od przewodu? Wyjaśnia to zjawisko indukcji elektromagnetycznej i prace Michaela Faradaya: zmienne pole magnetyczne może indukować prąd w sąsiednim przewodniku. W przypadku anteny, zmienne pole wokół drgających elektronów „indukuje” zaburzenie pola dalej i dalej, fala elektromagnetyczna niesie energię od anteny w dalekie okolice. Tę samą zasadę, tylko odwróconą, wykorzystuje antena odbiorcza. Gdy fala radiowa dotrze do odbiornika, zmienne pole elektryczne fali zaczyna poruszać elektronami w antenie odbiorczej, wymuszając w niej prąd o częstotliwości takiej samej, z jaką drga pole fali. Innymi słowy, sygnał radiowy dociera do anteny i wywołuje w niej słabiutki prąd zmienny, dokładnie taki sam, jaki nadajnik wysłał, tylko znacznie słabszy. Dzięki temu odbiornik „czuje” obecność fali i może z niej wydobyć informację.

Jak spośród mnóstwa fal wybrać tę, której chcemy słuchać (np. konkretną stację radiową)? Tutaj z pomocą przychodzi zjawisko rezonansu elektromagnetycznego. Każda antena z obwodem rezonansowym (najczęściej tzw. obwodem LC, z cewką i kondensatorem) posiada swoją częstotliwość własną drgań. Jeśli dostarczymy sygnał o właśnie takiej częstotliwości, antena odbiorcza zacznie wibrować (indukować prąd) znacznie mocniej „stroi się” do tej częstotliwości, wzmacniając sygnał, a ignorując inne. Strojenie radia polega więc na dostosowaniu obwodu rezonansowego odbiornika do częstotliwości nadawanej przez wybraną stację. Dawniej realizowano to przez kondensator o zmiennej pojemności – kręcąc gałką, zmienialiśmy parametry obwodu i wybieraliśmy np. 102,4 MHz z morza innych fal. Gdy obwód zarezonuje z falą danej stacji, sygnał tej częstotliwości jest wychwytywany i wzmacniany, a pozostałe częstotliwości – odfiltrowane. A jeśli chcesz zobaczyć, jak podobne problemy sygnałowe i zakłócenia analizuje się już w praktyce sieciowej, zajrzyj do wpisu Diagnostyka sieci LAN – warstwa L1 i L2.

W skrócie:

- Fala radiowa powstaje, gdy ładunki elektryczne drgają w antenie.

- Antena nadawcza wysyła falę, a odbiorcza zamienia ją z powrotem na sygnał elektryczny.

- Rezonans pozwala odbiornikowi „wyłowić” jedną konkretną częstotliwość spośród wielu.

Skąd naprawdę biorą się fotony? Głębsze spojrzenie na promieniowanie

W poprzednim opisie fale radiowe zostały przedstawione w klasyczny, prosty sposób: elektrony drgające w antenie wytwarzają zmienne pole elektromagnetyczne, które rozchodzi się w przestrzeni jako fala. To podejście jest w pełni poprawne i w praktyce inżynierskiej całkowicie wystarczające do zrozumienia działania telekomunikacji radiowej, ale fizyka „pod spodem” jest jeszcze ciekawsza.

Najważniejsza zasada brzmi: każdy ładunek elektryczny, który zmienia swój ruch, emituje promieniowanie elektromagnetyczne. Nie musi to być prąd zmienny w przewodzie. Wystarczy, że elektron przyspiesza, hamuje albo zmienia kierunek. Wtedy oddaje część swojej energii do otoczenia.

W świecie makroskopowym, takim jak antena, widzimy to jako ciągłą falę. Jednak w skali atomowej energia nie jest emitowana dowolnie, lecz w porcjach – kwantach, czyli fotonach. Energię pojedynczego fotonu opisuje prosty wzór:

E = h × f

gdzie:

- E – energia fotonu,

- f – częstotliwość,

- h – stała Plancka.

Ponieważ częstotliwość i długość fali są powiązane zależnością:

c = λ × f

to ten sam związek można zapisać także tak:

E = h × c / λ

Z tego wynika prosta rzecz: krótsza fala oznacza większą energię, a dłuższa – mniejszą. Dlatego fale radiowe mają małą energię, a promieniowanie X bardzo dużą.

Ten sam mechanizm emisji działa w bardzo różnych sytuacjach.

W antenie, czyli w przewodniku z metalu, mamy ogromną liczbę elektronów. Poruszają się one razem, w uporządkowany sposób, więc emitowane promieniowanie ma charakter ciągły i niską energię. To właśnie fale radiowe. Można powiedzieć, że antena produkuje niewyobrażalnie dużą liczbę bardzo słabych fotonów.

W atomie sytuacja jest inna. Elektron nie może mieć dowolnej energii, tylko określone poziomy. Gdy przechodzi z wyższego poziomu na niższy, różnica energii musi zostać oddana. Nie rozlewa się ona ciągle, tylko pojawia się jako pojedynczy foton o konkretnej energii. To dlatego różne pierwiastki świecą charakterystycznymi kolorami.

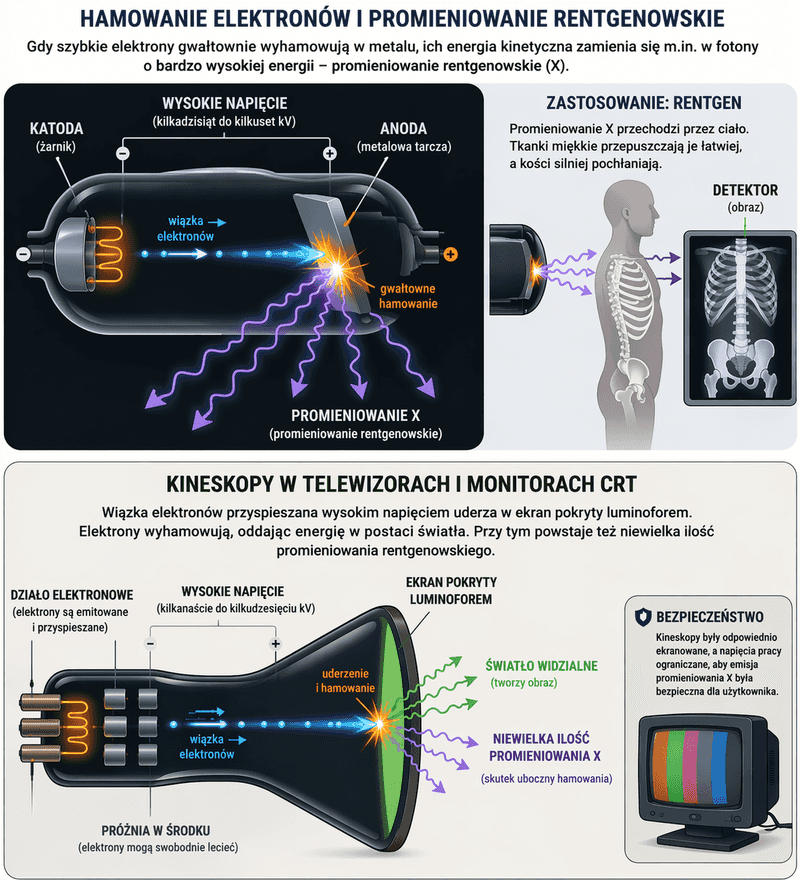

Jeszcze bardziej spektakularnym przypadkiem jest hamowanie elektronów. Jeśli bardzo szybki elektron nagle zostanie zatrzymany (np. uderzy w metal), jego energia kinetyczna musi gdzieś się podziać. Część tej energii zamienia się w fotony o bardzo wysokiej energii – powstaje promieniowanie rentgenowskie. Im gwałtowniejsze hamowanie, tym większa energia i krótsza fala. Na tej zasadzie działa aparat rentgenowski. W jego wnętrzu elektrony są rozpędzane wysokim napięciem i kierowane na metalową tarczę (anodę), gdzie gwałtownie wyhamowują. W wyniku tego powstaje promieniowanie X, które przenika przez ciało – tkanki miękkie przepuszczają je łatwiej, a kości silniej pochłaniają, co pozwala uzyskać obraz na detektorze.

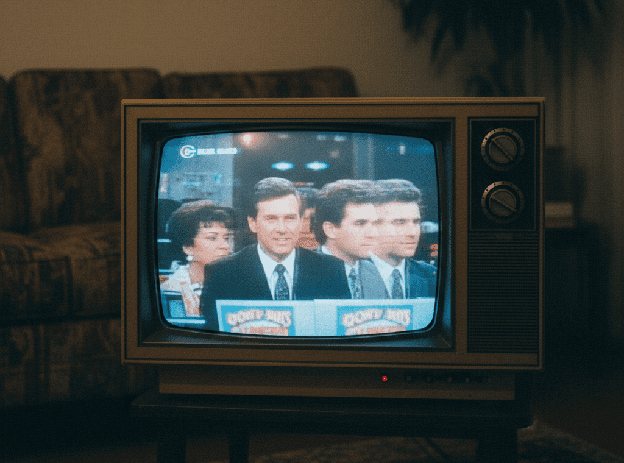

Ciekawym i bardziej „domowym” przykładem tego zjawiska były dawne kineskopy w telewizorach i monitorach CRT. W ich wnętrzu wiązka elektronów była przyspieszana wysokim napięciem i kierowana na ekran pokryty luminoforem. Gdy elektrony uderzały w powierzchnię ekranu, wyhamowywały, oddając energię w postaci światła widzialnego – to właśnie ono tworzyło obraz. Jednak oprócz światła powstawała także niewielka ilość promieniowania rentgenowskiego, wynikająca z gwałtownego hamowania elektronów. Z tego powodu kineskopy były odpowiednio ekranowane, a napięcia pracy ograniczane, aby emisja promieniowania była bezpieczna dla użytkownika.

Ciekawy efekt pojawia się też wtedy, gdy elektron nie zwalnia, ale zmienia kierunek ruchu. W akceleratorach cząstek elektrony poruszają się z ogromnymi prędkościami i są zakrzywiane przez pola magnetyczne. Sam fakt skrętu oznacza przyspieszenie, więc elektrony emitują promieniowanie – tzw. synchrotronowe. W odróżnieniu od prostego hamowania, tutaj energia jest tracona w sposób ciągły wzdłuż toru ruchu. Moc emitowanego promieniowania rośnie bardzo silnie wraz z energią elektronu (w przybliżeniu jak 𝛾^4, gdzie 𝛾 to czynnik relatywistyczny), dlatego zjawisko staje się istotne dopiero przy bardzo wysokich energiach. Dodatkowo promieniowanie jest silnie kierunkowe – dla relatywistycznych elektronów jest emitowane w wąskim stożku zgodnym z kierunkiem ich ruchu. Widmo tego promieniowania jest szerokie i ciągłe, sięgające często zakresu rentgenowskiego. W praktyce oznacza to, że synchrotron staje się bardzo wydajnym źródłem wysokoenergetycznych fotonów. Z jednej strony jest to efekt uboczny, który trzeba kompensować (bo elektrony tracą energię), a z drugiej, celowo wykorzystywane źródło promieniowania o wysokiej jasności i precyzyjnych właściwościach.

Wszystkie te zjawiska łączy jedna zasada: zmiana ruchu elektronu oznacza emisję energii. Różni się tylko skala i energia zjawiska.

Dlatego na antenę można spojrzeć nie tylko jak na element obwodu elektrycznego, ale też jak na układ, który w kontrolowany sposób zmusza elektrony do ruchu, a więc do emisji ogromnej liczby fotonów o bardzo małej energii. To właśnie z tych drobnych „cegiełek” powstaje fala radiowa, którą odbiera nasze radio.

W skrócie:

- Każda zmiana ruchu elektronu może powodować emisję promieniowania elektromagnetycznego.

- Fale radiowe to bardzo mało energetyczna część widma elektromagnetycznego.

- Antena emituje ogromną liczbę słabych fotonów, które razem tworzą falę radiową.

Początki radia: iskra, telegraf i sygnały cyfrowe

Pierwsze praktyczne zastosowanie radia nie polegało bynajmniej na przesyłaniu głosu czy muzyki. Radio początkowo służyło jako telegraf bez drutu. Wynalazcy radia chcieli uwolnić telegrafię od kabli – marzyli o przekazywaniu wiadomości Morse’a na odległość bez połączenia drutowego. Nic dziwnego, że pierwsze transmisje radiowe przypominały sygnały telegraficzne: fala jest albo jej nie ma. Nadajnik wysyłał krótkie impulsy (błyski fal elektromagnetycznych) przerywane pauzami. Odbiornik rejestrował to najczęściej jako serię trzasków. Te trzaski – krótsze lub dłuższe – układały się w kropki i kreski alfabetu Morse’a, pozwalając przesyłać litery i całe wiadomości. Była to zatem komunikacja binarna w najczystszej postaci: sygnał „1” gdy fala jest nadawana, i „0” gdy jej brak. Można powiedzieć, że radio od samego początku miało geny transmisji cyfrowej, choć nikt wtedy tak tego nie nazywał.

Pierwsze radiotelegraficzne wiadomości były przełomowe. Już wspomniany sygnał litery S przesłany przez Atlantyk w 1901 roku pokazał, że można komunikować się na odległość tysięcy kilometrów bez drutu. W kolejnych latach rozwinął się cały system komunikacji morskiej oparty o telegrafię radiową – statki wyposażone w nadajniki iskrowe mogły wołać o pomoc czy przekazywać depesze z pełnego morza. Gdy w 1912 roku Titanic zderzył się z górą lodową, jego radiooperator bez wahania nadał na falach eteru sygnał „SOS” (trzy kropki, trzy kreski, trzy kropki). Sygnał ten został odebrany przez inne statki i stacje brzegowe, co umożliwiło podjęcie akcji ratunkowej. Był to głośny dowód na skuteczność „bezprzewodowego telegrafu”. Od tej pory wyposażenie statku w radiostację stało się standardem, a zawód radiooperatora – kluczowy w żegludze.

1897 rok - historyczne zdjęcie przedstawia jedne z pierwszych eksperymentów z bezprzewodową transmisją sygnału. Proste generatory iskrowe i anteny pozwalały przesyłać krótkie impulsy jeszcze bez dźwięku, ale już bez kabli. To właśnie od takich prób rozpoczęła się era komunikacji radiowej, która zrewolucjonizowała świat.

W początkach radia nie transmitowano jeszcze dźwięku mowy ani muzyki, bo technologia nie była do tego dostosowana. Wykorzystywano tzw. nadajniki iskrowe, które generowały przerywany sygnał szerokopasmowy (trochę jak ciągłe wyładowania elektryczne, iskrzenie – stąd nazwa). Taki sygnał świetnie nadawał się do przesyłania impulsów Morse’a, ale nie dało się na nim łatwo nałożyć płynnych zmian odpowiadających falom akustycznym. W praktyce więc radiokomunikacja początku XX wieku była w pełni analogowa pod względem nośnej, ale przekazywała informację w sposób cyfrowy (zero-jedynkowy – fala jest albo jej nie ma). Można to porównać do współczesnego kluczowania on-off (OOK), jednej z prostszych form modulacji cyfrowej.

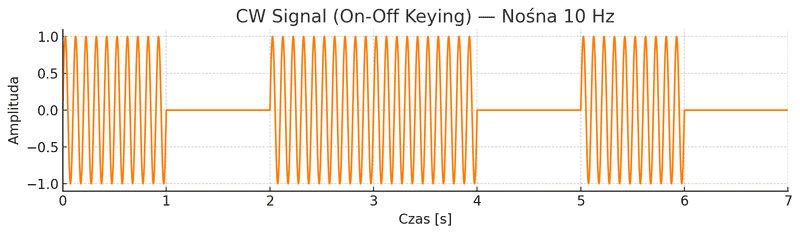

Modulacja telegraficzna CW (Continuous Wave) to najprostszy sposób przesyłania informacji przy użyciu fali radiowej. Fala nośna ma stałą częstotliwość, ale jest włączana dla bitu „1” i wyłączana dla bitu „0”. W praktyce odpowiada to nadawaniu kropek i kresek alfabetu Morse’a – włączony nadajnik oznacza impuls, wyłączony – przerwę.

Mimo prostoty, ta metoda była fundamentem radiokomunikacji: pozwalała na bardzo dalekie łączności przy niewielkiej mocy nadajnika i dużej odporności na zakłócenia.

Głos przez eter: modulacja amplitudy (AM) i częstotliwości (FM)

Kolejny wielki krok w rozwoju radia to przesyłanie dźwięku – ludzkiego głosu, muzyki i efektów akustycznych. Aby to osiągnąć, inżynierowie musieli wymyślić, jak „zapakować” sygnał audio w falę radiową. Bezpośrednie nadawanie dźwięku jako fali elektromagnetycznej jest niewykonalne – częstotliwości dźwiękowe (kilkadziesiąt lub kilkaset Hz) są za niskie, by taka fala efektywnie się rozchodziła, a dodatkowo zajmowałyby ogromny kawałek widma radiowego. Rozwiązaniem okazało się użycie fali nośnej o bardzo wysokiej częstotliwości, która „niesie” dźwięk. Proces nakładania informacji, na przykład dźwięku, na falę nośną nazywamy modulacją.

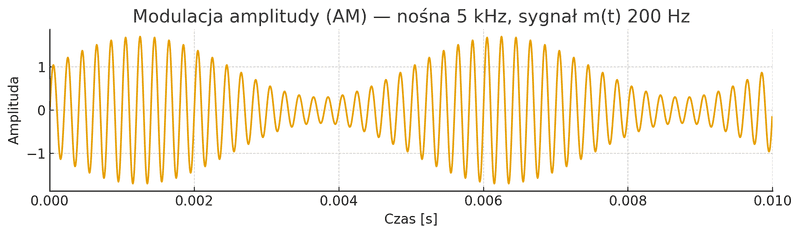

Najprostszym sposobem modulacji jest zmiana amplitudy fali nośnej w rytm sygnału informacyjnego. Jeżeli mamy falę nośną – wyobraźmy sobie dla uproszczenia szybki sinus o stałej amplitudzie – to zmieniając jej amplitudę zgodnie ze zmianami sygnału audio, sprawiamy, że „falowanie” tej amplitudy odwzorowuje dźwięk. Tę technikę nazwano AM (ang. Amplitude Modulation, modulacja amplitudy). W modulacji AM amplituda fali nośnej zmienia się zgodnie z sygnałem audio, podczas gdy częstotliwość pozostaje stała. Odbiornik potrafi wychwycić obwiednię amplitudy fali i odtworzyć z niej pierwotny dźwięk. Pierwsze transmisje głosowe i muzyczne korzystały właśnie z modulacji amplitudy – już w 1906 roku, podczas opisanej audycji bożonarodzeniowej, użyto fali nośnej o stałej częstotliwości, której amplitudę zmieniano w takt muzyki i mowy. W latach 20. i 30. XX wieku radiofonia opierała się głównie na radiu AM – stacje długofalowe, średniofalowe czy krótkofalowe nadawały modulację amplitudy, co pozwalało słuchaczom odbierać audycje na domowych detektorach i pierwszych radiach lampowych.

Modulacja amplitudy (AM) — wysokość fali nośnej zmienia się zgodnie z sygnałem audio. Tam, gdzie dźwięk jest głośniejszy, amplituda rośnie; gdzie cichszy – maleje. To najstarszy sposób przesyłania dźwięku w radiu.

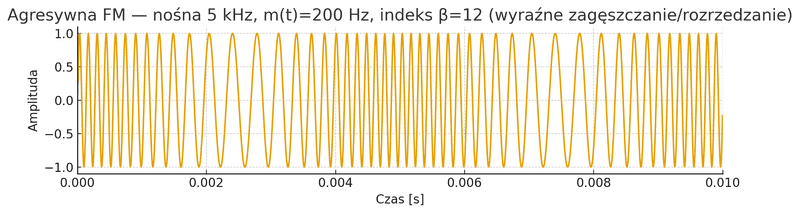

Modulacja AM była przełomowa, ale ma swoje wady. Sygnał AM jest dość podatny na zakłócenia – wszelkie trzaski, wyładowania atmosferyczne czy szumy wpływają na amplitudę fali i tym samym od razu degradują odbierany dźwięk (stąd charakterystyczne „trzaski” w starym radiu). Ponadto, w sygnale AM część mocy fali nośnej się marnuje (niesie ona mniej informacji, a zajmuje energię). Dlatego zaczęto poszukiwać innej metody, bardziej odpornej na zakłócenia. Rozwiązaniem okazała się modulacja częstotliwości, czyli FM (ang. Frequency Modulation). W modulacji FM amplituda fali nośnej jest stała, za to częstotliwość fali nośnej jest delikatnie zwiększana lub zmniejszana zgodnie z sygnałem audio. Gdy dźwięk ma większą chwilowo amplitudę (głośniejszy fragment), nośna nieco przyspiesza lub zwalnia – te mikro-wahania częstotliwości niosą informację o przebiegu dźwięku. Odbiornik FM „śledzi” zmianę częstotliwości fali i na tej podstawie odtwarza audio.

Ciekawostka: kiedy trawa gra radio

W internecie można znaleźć niezwykły film zatytułowany „Listening radio with grass”, w którym dwóch pasjonatów pokazuje, jak można... usłyszeć audycję radiową w dźwiękach łuku elektrycznego powstającego między anteną a źdźbłem trawy. Film ma ponad 1,5 miliona wyświetleń i pokazuje eksperyment o nazwie singing arc – dosłownie „śpiewający łuk”.

„Listening radio with grass” – klasyczny eksperyment z „śpiewającym łukiem”.

Dlaczego to działa?

Łuk elektryczny zachowuje się jak głośnik plazmowy: prąd przepływający przez powietrze, czyli zjonizowany gaz, zmienia się zgodnie z falą radiową. Ponieważ stacja radiowa AM jest modulowana amplitudowo, zmiany siły sygnału powodują drgania gęstości i temperatury w łuku. Powietrze rozszerza się i kurczy w rytm sygnału audio, dzięki czemu łuk dosłownie odtwarza dźwięk radia.

Eksperyment ten jest bardzo niebezpieczny, bo wymaga pracy z wysokim napięciem i falami radiowymi dużej mocy, ale doskonale pokazuje, że modulacja amplitudy przenosi dźwięk nie tylko przez głośnik, lecz również przez samą elektryczność i powietrze.

Radio FM zostało wprowadzone na szerszą skalę w latach 30. XX wieku (pionierem był Edwin Armstrong). Zalety modulacji częstotliwości szybko doceniono: dźwięk nadawany w FM ma znacznie lepszą jakość, szersze pasmo przenoszenia i mniej szumów niż w AM. Ponieważ zakłócenia (np. elektryczne trzaski) zazwyczaj wpływają głównie na amplitudę fali, a nie na jej dokładną częstotliwość, odbiornik FM potrafi je zignorować – w efekcie szumy tła są mocno wytłumione. Dlatego właśnie na paśmie UKF (ultrakrótkofalowym, ~88–108 MHz) do dziś nadaje się radio stereofoniczne w modulacji FM – dzięki temu możemy cieszyć się czystą muzyką bez trzasków.

Modulacja częstotliwości (FM) — amplituda fali pozostaje stała, ale jej gęstość (czyli częstotliwość chwilowa) rośnie i maleje zgodnie z sygnałem dźwiękowym. Im dźwięk jest głośniejszy, tym częstotliwość chwilowa bardziej się odchyla od wartości środkowej. Dzięki temu FM jest znacznie odporniejsza na zakłócenia i zapewnia czystszy, wyraźniejszy dźwięk niż modulacja amplitudy.

Podsumowując, dwie podstawowe analogowe metody modulacji to:

- AM (modulacja amplitudy) – zmieniamy amplitudę fali nośnej zgodnie z przebiegiem sygnału audio.

- FM (modulacja częstotliwości) – zmieniamy częstotliwość fali nośnej zgodnie z przebiegiem sygnału audio.

Obie te metody pozwoliły zamienić radio z urządzenia wysyłającego krótkie sygnały w prawdziwy środek przekazu dźwięku. Do lat 90. XX wieku praktycznie wszystkie transmisje radiowe audio – zarówno radiofonia, jak i analogowa telewizja – wykorzystywały którąś z tych modulacji. Choć dziś coraz więcej przekazów odbywa się cyfrowo, AM i FM nadal są w użyciu i stanowią podstawę klasycznej techniki radiowej.

W skrócie:

- AM zmienia amplitudę fali nośnej.

- FM zmienia częstotliwość fali nośnej.

- FM daje zwykle lepszą jakość dźwięku i większą odporność na zakłócenia.

Trzeci sposób: modulacja fazy (PM)

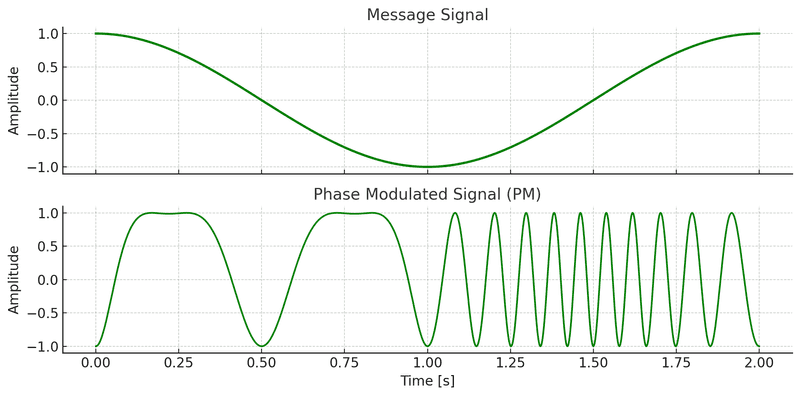

Warto wspomnieć, że istnieje jeszcze trzeci podstawowy parametr fali, który można modyfikować – faza. Modulacja fazy (ang. Phase Modulation, PM) polega na tym, że zmieniamy chwilową fazę fali nośnej zgodnie z sygnałem informacyjnym. Mówiąc obrazowo, falę możemy nieco „przesunąć” w czasie w jedną lub drugą stronę zależnie od amplitudy sygnału audio. Jeśli sygnał jest zero – nadajemy falę w normalnej fazie, jeśli sygnał maksymalny – przesuwamy fazę np. o 90 stopni, i tak dalej (to tylko ilustracja zasady). W czystej postaci analogowa modulacja fazy nie zdobyła dużej popularności w klasycznej radiofonii – znacznie łatwiej i skuteczniej było wykorzystać AM albo FM. Modulacja fazy jest jednak blisko spokrewniona z FM (zmiany fazy to w istocie przyspieszanie i opóźnianie fali, czyli zmiana częstotliwości na krótką chwilę). Zaletą takiej modulacji jest, podobnie jak przy FM, pewna odporność na zakłócenia amplitudowe.

Modulacja fazy (PM), fala zachowuje stałą amplitudę i częstotliwość, ale jej faza (czyli pozycja szczytów i dolin) zmienia się w zależności od sygnału modulującego. W miejscach, gdzie sygnał wiadomości rośnie, grzbiety fali przesuwają się w przód, a gdzie maleje, cofają się, tworząc efekt zagęszczania i rozrzedzania przebiegów.

Choć analogowe PM nie zrobiło kariery w eterze, stało się bardzo ważne w systemach cyfrowych. Informację można bowiem kodować w dyskretnych zmianach fazy fali – i tak narodziła się cała rodzina modulacji cyfrowych PSK (Phase Shift Keying), gdzie np. dwie wartości fazy oznaczają bit 0 lub 1 (BPSK), cztery wartości fazy oznaczają dwubitowe symbole (QPSK), itd. Jeśli zaś połączymy modulację fazy i amplitudy, dostaniemy jeszcze potężniejsze narzędzie – o nim poniżej. Można zatem powiedzieć, że trzy kierunki modulacji to amplituda, częstotliwość i faza. Kombinując je, inżynierowie opracowali metody pozwalające w pełni wykorzystać potencjał fali elektromagnetycznej.

Cyfrowa rewolucja: OFDM, QAM i odporność na zakłócenia

Transmisje analogowe (AM, FM, PM) wyniosły radio na szczyty popularności, ale mają też ograniczenia. Jakość analogowego sygnału jest silnie uzależniona od zakłóceń – im słabszy sygnał i więcej szumów, tym gorszy dźwięk lub obraz po demodulacji. Każda dodatkowa fala zakłócająca czy echo sygnału odbite od budynków powoduje zniekształcenia słyszalne jako szum, trzask lub interferencje (np. charakterystyczne „duszenie” sygnału przy słabym zasięgu FM). Ponadto analogowe systemy nie posiadają mechanizmów korekcji błędów – jeśli coś zakłóci fragment audycji, po prostu to słyszymy jako zakłócenie. Technika cyfrowa pozwala złagodzić te bolączki. Zamiast przekazywać sygnał ciągły (falę dźwiękową) bezpośrednio, można najpierw zakodować go w postaci ciągu bitów 0/1, a następnie bity te transmitować falą radiową za pomocą odpowiednio zaplanowanej modulacji cyfrowej. Taki system może wykrywać i korygować błędy (dzięki nadmiarowym kodom korekcyjnym), a szumy o ile nie są zbyt silne – nie pogarszają jakości odbioru (odbiornik wciąż poprawnie odczyta zera i jedynki). Dopiero gdy zakłócenia przekroczą pewien próg, transmisja cyfrowa „urywa się” całkowicie, co znamy choćby z efektu zatrzymującego się obrazu w telewizji cyfrowej lub zerwania połączenia Wi‑Fi. Zaletą jest jednak to, że do pewnego progu zakłóceń sygnał cyfrowy zachowuje pełnię jakości – obraz i dźwięk są idealnie odwzorowane.

Serce modulacji cyfrowych stanowi pomysł, by wykorzystać dwie własności fali nośnej: amplitudę i fazę. W ten sposób powstała modulacja QAM (Quadrature Amplitude Modulation), po polsku kwadraturowa modulacja amplitudowo-fazowa. W QAM informacja, czyli ciąg bitów, jest grupowana po kilka naraz, a każdej takiej grupie przypisuje się konkretny stan fali – określoną amplitudę i fazę nośnej. Można to pokazać na wykresie zwanym diagramem konstelacji, gdzie każda kombinacja bitów jest jednym punktem o określonych współrzędnych.

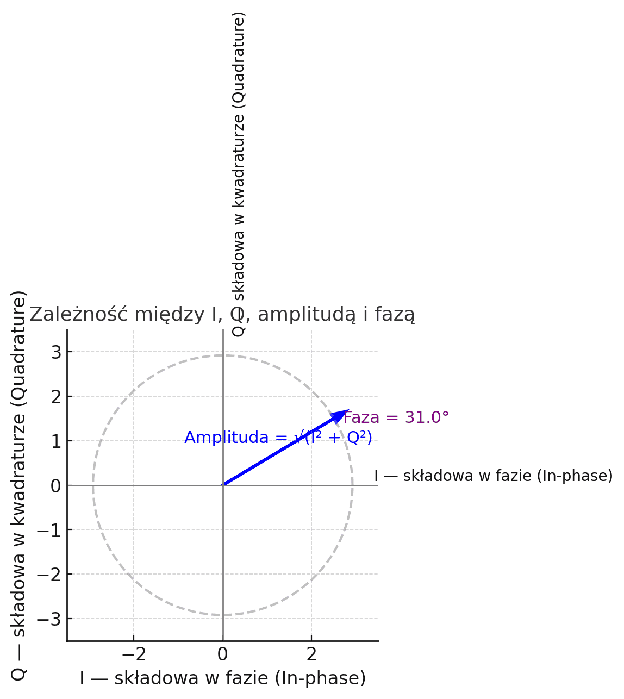

Zależność między składowymi I i Q, amplitudą i fazą sygnału. Wektor reprezentuje aktualny stan sygnału w przestrzeni I/Q – jego długość odpowiada amplitudzie, a kąt względem osi I oznacza fazę. To graficzne przedstawienie podstaw modulacji QAM i PSK, w których dane są kodowane przez zmianę amplitudy i/lub fazy fali nośnej.

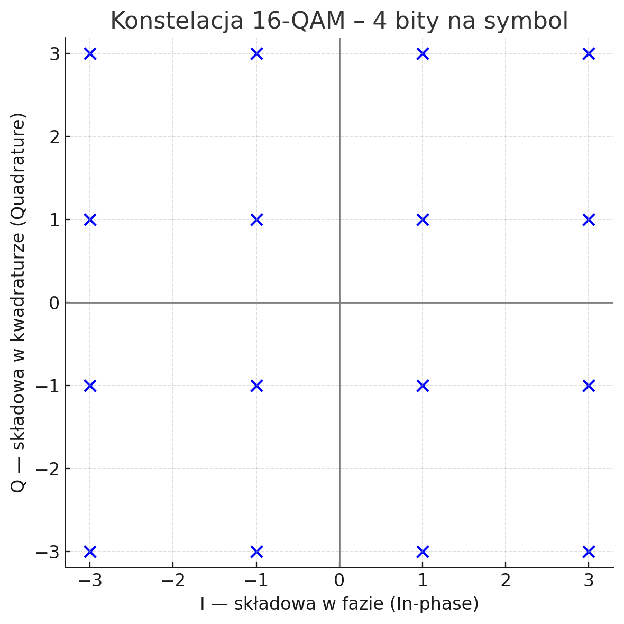

Przykładowy diagram konstelacji 16-QAM przedstawia 16 punktów. Każdy punkt odpowiada symbolowi złożonemu z 4 bitów, na przykład 1100 albo 0101. Na osi poziomej odkładana jest składowa w fazie (I), a na osi pionowej składowa kwadraturowa (Q). Amplituda sygnału odpowiada odległości punktu od środka układu, a faza – kątowi, pod jakim punkt leży względem osi poziomej. W praktyce oznacza to, że każda para wartości amplitudy i fazy reprezentuje inną porcję danych. W przypadku 16-QAM dostajemy 4 × 4 = 16 kombinacji, czyli 4 bity informacji na symbol.

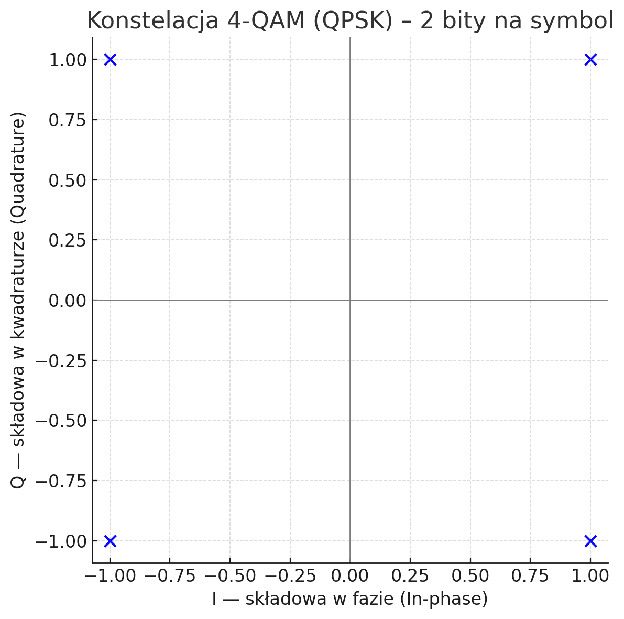

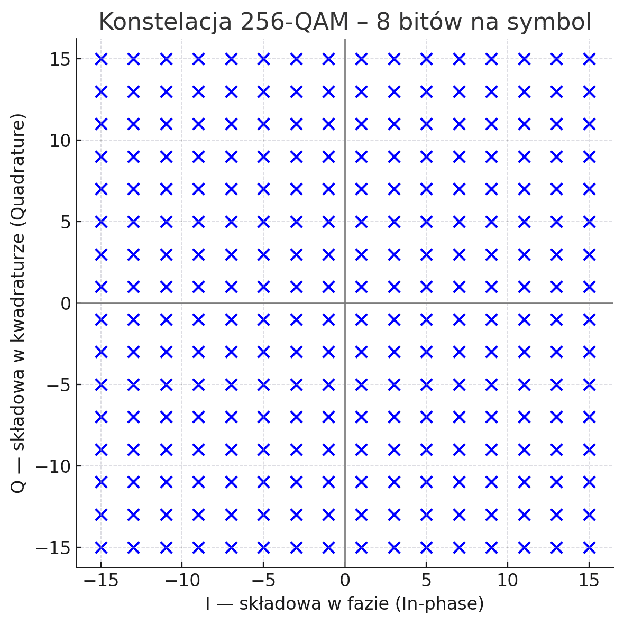

Jeśli zwiększymy liczbę możliwych kombinacji, możemy przesłać więcej bitów jednocześnie. Np. 4-QAM (QPSK) posiada 4 punkty konstelacji i przenosi 2 bity na symbol, 16-QAM przenosi 4 bity, 64-QAM – 6 bitów, 256-QAM – 8 bitów, a nowoczesne systemy jak Wi‑Fi 6 stosują 1024-QAM, gdzie każdy symbol koduje aż 10 bitów danych. Oczywiście im więcej punktów w konstelacji, tym bliżej siebie one leżą – a to oznacza, że odbiornik musi rozróżniać bardzo niewielkie różnice amplitudy i fazy. Dlatego wysokie porządki QAM wymagają silnego sygnału i dobrego stosunku sygnał/szum. W praktyce urządzenia adaptują modulację do warunków – np. gdy Wi‑Fi ma słabszy zasięg, przełącza się z 256-QAM na prostszą 64-QAM lub QPSK, bo w szumie dalekiego zasięgu tylko mniej gęsta konstelacja zapewni bezbłędny odbiór.

Konstelacja 4-QAM (QPSK) – 2 bity na symbol. To najprostsza wersja modulacji QAM. Każdy punkt odpowiada jednej z czterech możliwych kombinacji bitów – reprezentuje inną fazę sygnału przy tej samej amplitudzie.

Konstelacja 16-QAM – 4 bity na symbol. Każdy punkt ma własną kombinację amplitudy i fazy. Dzięki 16 stanom można przesyłać dwa razy więcej informacji niż w 4-QAM, zachowując ten sam czas trwania symbolu.

Konstelacja 256-QAM – 8 bitów na symbol. To już zaawansowana modulacja stosowana w nowoczesnych systemach (np. Wi-Fi 6). Gęsto upakowane punkty konstelacji pozwalają przesłać więcej danych, ale wymagają bardzo czystego i silnego sygnału, by uniknąć błędów.

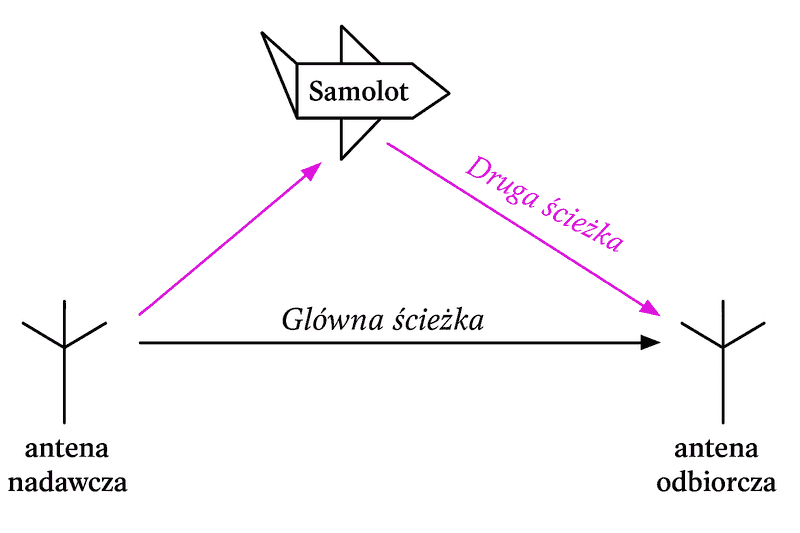

Modulacja QAM (amplitudowo-fazowa) jest bardzo wydajna, ale sama nie rozwiązuje wszystkich problemów, zwłaszcza jednego odwiecznego radiowego utrapienia: wielodrogowości sygnału. Wielodrogowość oznacza, że sygnał radiowy dociera do anteny odbiorczej różnymi drogami – na przykład jedna fala idzie bezpośrednio, inne odbijają się od budynków, gór czy warstw atmosfery.

Wielodrogowość sygnału radiowego – przykład odbioru sygnału głównego i odbitego od samolotu. Różnica dróg powoduje przesunięcia fazy i interferencję.

Te opóźnione kopie nakładają się na siebie. Jeśli różnice czasu dotarcia są niewielkie, może dojść do interferencji (wzmocnienia lub osłabienia sygnału). Gorsza sytuacja jest wtedy, gdy opóźnienia są porównywalne z długością przesyłanego symbolu danych – wtedy kopie zaczynają się na siebie nakładać w czasie, co oznacza, że odbiornik jednocześnie odbiera kawałki kilku symboli naraz zamiast jednego. Taki chaos utrudnia albo wręcz uniemożliwia poprawne odczytanie informacji. W analogowej telewizji efektem wielodrogowości były np. „duchy” obrazu (widoczne przesunięte kontury, bo sygnał docierał dwukrotnie: raz bezpośrednio i raz z opóźnieniem po odbiciu).

Efekt wielodrogowości w telewizji analogowej, odbicia sygnału powodują powstawanie „duchów” (podwójnych konturów obrazu).

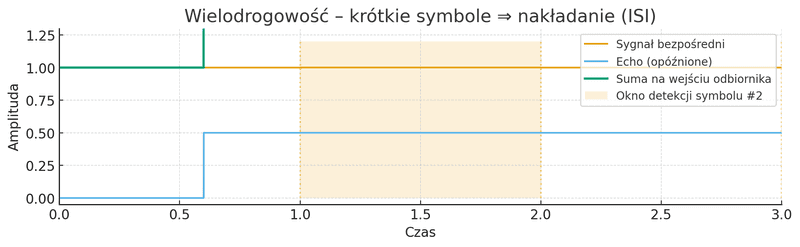

W łączności cyfrowej objawia się to zwiększonym poziomem błędów. Jak sobie z tym poradzono?

Wielodrogowość w klasycznych systemach (ISI, czyli interferencja międzysymbolowa). Echo opóźnione o 0.6 × Ts wpada w okno detekcji kolejnego symbolu i utrudnia poprawny odbiór.

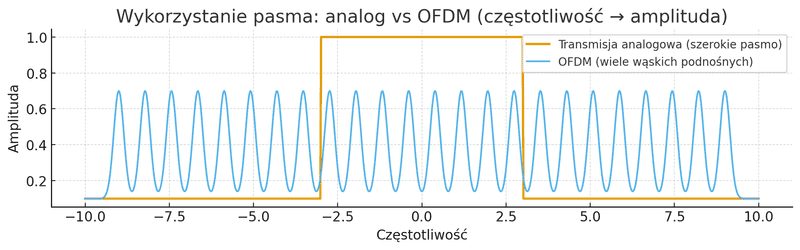

Rozwiązaniem okazała się technika OFDM (Orthogonal Frequency Division Multiplexing), czyli ortogonalnego podziału w dziedzinie częstotliwości. Brzmi skomplikowanie, ale idea jest prosta: zamiast wysyłać jeden bardzo szybki strumień bitów upakowany w wysokosymbolową modulację, OFDM dzieli transmisję na wiele wolniejszych strumieni równoległych. Każdy z tych strumieni jest nadawany na innej podnośnej częstotliwości (stąd „multikarier” – wiele nośnych), a wszystkie te nośne są tak dobrane, że wzajemnie sobie nie przeszkadzają (są ortogonalne, co matematycznie oznacza zerową interferencję między nimi mimo nakładania widmowego). Dzięki podziałowi sygnału o dużej przepływności na wiele wolniejszych kanałów, system staje się odporniejszy na zjawisko wielodrogowości.

Wykorzystanie pasma w transmisji OFDM. Na wykresie porównano klasyczną transmisję analogową (żółta linia), która zajmuje szerokie pasmo częstotliwości, z techniką OFDM (niebieska linia), w której wiele wąskich podnośnych przenosi dane równocześnie.

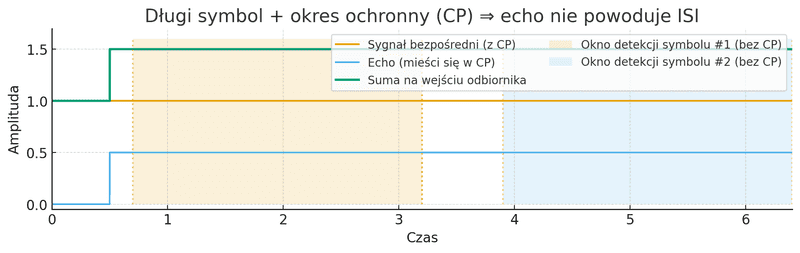

Nawet jeśli któraś z podnośnych ulegnie zanikowi lub opóźnieniu, pozostałe docierają poprawnie, a błędne fragmenty da się skorygować. Co ważne, symbol danych w każdym wolnym strumieniu jest na tyle długi (czas trwania symbolu jest odwrotnie proporcjonalny do szerokości pasma podnośnej), że echa nie nakładają się na kolejny symbol – najwyżej mieszczą się w tzw. okresie ochronnym. OFDM wprowadza bowiem krótką przerwę (tzw. cykliczny prefiks) między symbolami, która pozwala odseparować odbite sygnały przychodzące z opóźnieniem. W efekcie odbiornik może zsumować sygnały z różnych dróg zamiast cierpieć z powodu ich interferencji – fale wzmacniają się zamiast wykańczać.

Dłuższy symbol + okres ochronny (cykliczny prefiks, CP) Ten sam scenariusz, ale symbol jest dłuższy, a echo mieści się w CP — okno detekcji obejmuje tylko część „użyteczną”, więc brak ISI.

Dzięki OFDM nowoczesne systemy radiowe potrafią znakomicie wykorzystać kanał. Wiele wąskich podnośnych jest upakowanych w jednym kanale częstotliwości tak gęsto, że aż na styk – a mimo to nie zakłócają się wzajemnie (są idealnie ortogonalne). Na dodatek na każdej podnośnej można zastosować wydajną modulację QAM. Rezultat? Niesamowite prędkości transmisji i solidność sygnału. Przykładowo w standardzie Wi‑Fi 5 (802.11ac) używa się 256-QAM oraz 52 (lub więcej) podnośnych OFDM w jednym kanale, co umożliwia przesyłanie setek megabitów na sekundę w paśmie 5 GHz. W telewizji cyfrowej DVB-T2 stosuje się nawet 32k podnośnych OFDM (około 32 tysiące nośnych!) z modulacją do 256-QAM – to pozwala zmieścić kilka kanałów HD TV w jednym paśmie 8 MHz z doskonałą jakością i odpornością na zakłócenia, czego dawny analogowy sygnał nigdy by nie osiągnął.

W skrócie:

- QAM koduje dane przez zmianę amplitudy i fazy sygnału.

- OFDM dzieli transmisję na wiele wolniejszych podnośnych, co poprawia odporność na odbicia i zakłócenia.

- To właśnie dzięki QAM i OFDM działają dziś szybkie sieci Wi‑Fi, DVB-T i 5G.

Zastosowania: od telewizji cyfrowej po Wi‑Fi

Technologie OFDM i QAM zrewolucjonizowały łączność bezprzewodową i przewodową, dlatego dziś są wszechobecne. Cyfrowa telewizja naziemna DVB-T/T2 wykorzystuje OFDM (tysiące nośnych) z modulacją QAM do przesyłania obrazów i dźwięku wysokiej rozdzielczości. Szerokopasmowy internet w kablu telefonicznym (ADSL/VDSL) również opiera się na koncepcji DMT, będącej odmianą OFDM – dzieli pasmo na setki podkanałów, aby pokonać zakłócenia na długiej miedzianej linii. Wi‑Fi od standardu 802.11a (5 GHz) w górę także nadaje OFDM – np. Wi‑Fi 5 i 6 wysyłają dane 64 lub 256 podnośnymi jednocześnie, modulowanymi wysokimi QAM. Również standardy komórkowe 4G LTE i 5G NR komunikują się za pomocą OFDM na dole i górze pasma – LTE wprowadziło OFDM na szeroką skalę, a 5G NR (New Radio) dalej go rozwija, oferując elastyczne podziały pasma i jeszcze większe modulacje (nawet 1024-QAM w niektórych przypadkach). Dzięki temu najnowsze sieci komórkowe potrafią zapewnić zarówno gigabitowe prędkości, jak i niski ping, jednocześnie obsługując wielu użytkowników. W praktyce takie szybkie łącza są dziś tylko początkiem drogi danych – dalej trafiają one do warstw obliczeniowych i storage, o których szerzej piszemy w artykule Architektura Ceph, CRUSH i RADOS bez tajemnic.

W praktyce trudno dziś znaleźć obszar łączności bezprzewodowej, który nie korzysta z opisanych rozwiązań. Radio cyfrowe DAB+, telewizja satelitarna DVB-S2, sieci 5G, systemy LTE/4G, Wi‑Fi, Bluetooth (modulacja QAM w nowych wersjach), komunikacja w kosmosie – wszędzie tam modulacje cyfrowe i wielodostęp zapewniają niezawodność i szybkość. Nawet tradycyjne pasma radiowe mają swoje cyfrowe odpowiedniki (np. emisja DRM dla fal krótkich, czy cyfrowe systemy łączności służb jak TETRA). Można śmiało powiedzieć, że era szumu i trzasków ustąpiła miejsca erze bitów i konstelacji punktów. A tam, gdzie dane trzeba przetwarzać jak najbliżej miejsca ich powstania, duże znaczenie zyskuje także edge computing.

Łączność dwukierunkowa: jak współdzielić eter – szczeliny czasowe

Omówione modulacje i techniki sprawdzają się zarówno w transmisjach jednostronnych (np. radio, telewizja – gdzie jedna stacja nadaje do wielu odbiorców), jak i dwukierunkowych, gdzie wielu użytkowników nadaje i odbiera równocześnie (np. telefony komórkowe, sieci Wi‑Fi). Pojawia się jednak pytanie: skoro eter jest wspólny, to jak zorganizować jednoczesną komunikację wielu urządzeń, by sobie nie przeszkadzały? W eterze nie da się fizycznie odgrodzić użytkowników ścianami – trzeba zastosować podział w innej domenie. Stosuje się trzy główne metody: podział częstotliwości (każdy użytkownik dostaje inny kanał częstotliwościowy), podział kodu (każdy użytkownik ma inny kod rozpraszający sygnał – technika CDMA) oraz podział czasu. Skupmy się na tym ostatnim, bo koncepcja szczelin czasowych jest niezwykle istotna we współczesnych sieciach.

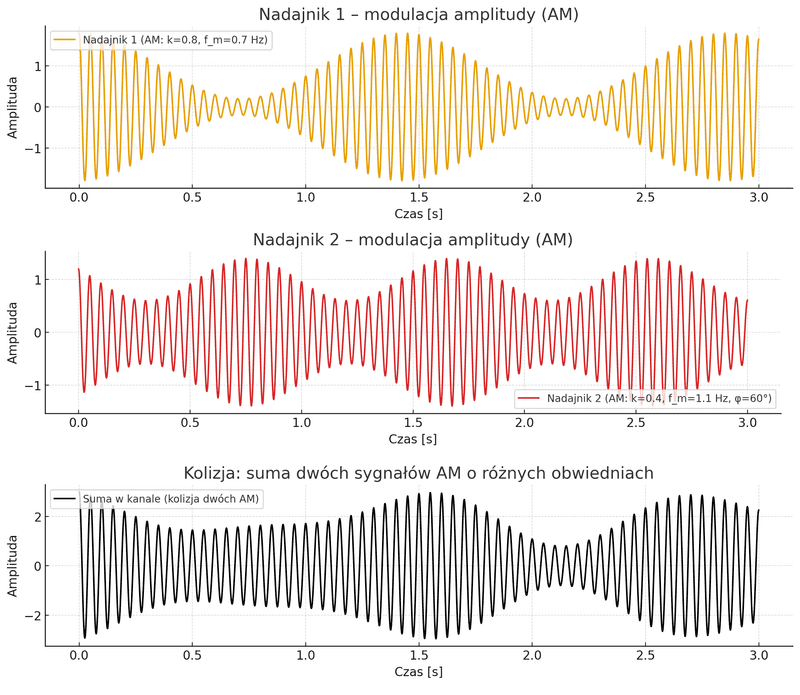

Kolizja dwóch sygnałów AM. Dwa sygnały o tej samej nośnej, lecz różnych obwiedniach, nakładają się w kanale, powodując zniekształcenia i interferencje utrudniające odbiór.

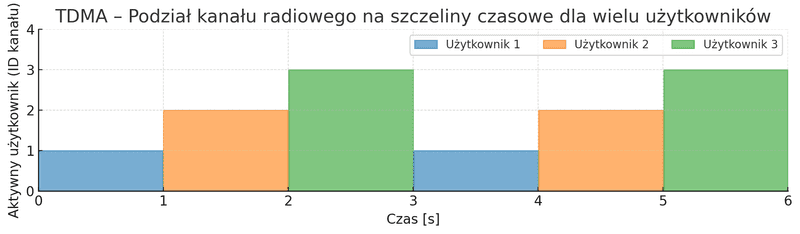

Szczelina czasowa to po prostu wydzielony kawałek czasu, podczas którego dane jednego urządzenia mogą być nadawane we wspólnym kanale. Można to porównać do sytuacji, w której kilku mówców dzieli jedną mównicę – każdy dostaje swoją minutę, po czym ustępuje miejsca kolejnej osobie. W telekomunikacji mówimy o TDM (Time Division Multiplexing) lub, gdy chodzi o wielu użytkowników, TDMA (Time Division Multiple Access). Czas dzieli się na krótkie porcje, a każdy użytkownik korzysta ze „swojej” szczeliny. Dzięki temu, choć wszyscy nadają na tej samej częstotliwości, nie robią tego jednocześnie – więc ich sygnały się nie zagłuszają.

Wykres przedstawia działanie TDMA (Time Division Multiple Access) – każdy użytkownik ma przydzieloną własną szczelinę czasową, w której może nadawać dane w tym samym kanale radiowym.

Klasycznym przykładem jest dawny system GSM (2G telefonii komórkowej). W GSM każda częstotliwość nośna była podzielona na 8 szczelin czasowych, tworzących ramkę TDMA. Jedna rozmowa zajmowała jedną szczelinę, więc na jednym kanale mogło naprzemiennie korzystać z łączności 8 osób. Każdy użytkownik dostawał „co ósmy” fragment czasu, w którym jego głos był wysyłany do stacji bazowej albo z niej odbierany. Dzięki temu ograniczano ryzyko kolizji, a pasmo było wykorzystywane znacznie efektywniej.

W nowszych systemach, takich jak LTE/4G i 5G, także stosuje się podział czasu, tylko w bardziej elastycznej formie. Sieć dzieli transmisję na ramki, sloty i symbole OFDM, a potem dynamicznie przydziela je użytkownikom. Choć brzmi to skomplikowanie, zasada jest nadal prosta: w danej chwili jeden użytkownik nadaje w swoim przydziale, a inny czeka na swoją kolej.

W sieciach Wi‑Fi klasycznych (np. 802.11n/ac) nie ma stałych szczelin czasowych – tam urządzenia uzgadniają dostęp „na bieżąco” (metodą nasłuchu i unikania kolizji CSMA/CA). Można to porównać do spontanicznej rozmowy wielu osób: każdy stara się wejść w słowo, gdy poprzednik skończy, a jeśli dwie osoby zaczną jednocześnie – obie milkną na chwilę i próbują ponownie. Jednak najnowsze Wi‑Fi 6 wprowadziło elementy OFDMA, czyli dzielenia zarówno częstotliwości, jak i czasu między wielu użytkowników – punkt dostępowy może jednocześnie rozmawiać z wieloma klientami, dzieląc dla nich podkanały i krótkie sloty czasu. W ten sposób zwiększa się efektywność sieci przy dużej liczbie urządzeń.

Koncepcja szczelin czasowych i ogólnie wielodostępu (multiple access) pozwala nam korzystać z komunikacji radiowej w tłumie użytkowników. Gdyby nie to, tylko jedna osoba naraz mogłaby korzystać np. z częstotliwości Wi‑Fi czy sieci komórkowej na danym obszarze! Dzięki sprytnemu podziałowi zasobów – czy to w czasie, w częstotliwości, czy za pomocą kodów – dziesiątki urządzeń mogą jednocześnie wysyłać i odbierać dane na jednej wspólnej przestrzeni radiowej, a my tego nawet nie zauważamy. Nasz smartfon może w jednej chwili odbierać pakiety internetowe, podczas gdy tuż obok inna osoba ogląda film online na laptopie, a kilka metrów dalej ktoś prowadzi rozmowę telefoniczną – i wszystkie te transmisje dzieją się równolegle, „przenikając się” w eterze, lecz logicznie rozdzielone dzięki technikom radiowym.

W skrócie:

- Eter jest wspólny, więc użytkownicy muszą dzielić go według czasu, częstotliwości albo kodu.

- TDMA i podobne techniki pozwalają wielu urządzeniom korzystać z jednego kanału bez chaosu.

- Dzięki temu sieci komórkowe i Wi‑Fi mogą obsługiwać wielu użytkowników jednocześnie.

Od fal radiowych do Wi-Fi i 5G

Komunikacja radiowa przeszła długą drogę od prostych impulsów telegraficznych do skomplikowanych, wielowątkowych transmisji danych. Wykorzystując zjawiska indukcji, modulacje analogowe i cyfrowe, sprytne podziały pasma i czasu, potrafimy dziś przesyłać gigantyczne ilości informacji przez przestrzeń – od głosu, przez muzykę, po filmy HD i dane internetowe. Patrząc wstecz, trudno nie odczuwać podziwu: to, co zaczęło się od trzasku iskry w laboratorium Hertza, dziś umożliwia nam streaming filmów i rozmowy wideo na żywo przez Wi‑Fi i 5G. Lord Kelvin nie miał racji – radio ma przyszłość, i to świetlaną, bo wciąż stanowi podstawę naszych bezprzewodowych połączeń ze światem.

Niezależnie od tego, czy mówimy o radiu, Wi-Fi, sieciach komórkowych czy systemach IoT, fundament pozostaje ten sam: kontrolowany ruch elektronów i fale, które niosą informację przez przestrzeń. Zmieniają się technologie, rosną prędkości i złożoność systemów, ale zasady fizyki odkryte ponad sto lat temu nadal stanowią ich podstawę.

FAQ – najczęstsze pytania o komunikację radiową

Jak działa komunikacja radiowa w skrócie?

Komunikacja radiowa działa dzięki falom elektromagnetycznym. Nadajnik wytwarza je za pomocą drgających ładunków elektrycznych w antenie, a odbiornik przechwytuje te fale i zamienia je z powrotem na sygnał elektryczny zawierający informację.

Czym są fale radiowe?

Fale radiowe to część widma elektromagnetycznego. Są to rozchodzące się w przestrzeni zmienne pola elektryczne i magnetyczne, które mogą przenosić energię i informację bez użycia przewodów.

Jaka jest różnica między AM i FM?

W modulacji AM zmienia się amplituda fali nośnej, a w modulacji FM zmienia się jej częstotliwość. FM zwykle lepiej radzi sobie z zakłóceniami i zapewnia czystszy dźwięk.

Co to jest fala nośna?

Fala nośna to fala o wysokiej częstotliwości, która „niesie” właściwą informację, na przykład głos, muzykę albo dane internetowe. Sama informacja jest na nią nakładana przez modulację.

Co to jest modulacja?

Modulacja to sposób zakodowania informacji na fali radiowej. Można zmieniać amplitudę, częstotliwość albo fazę sygnału, aby przenieść dźwięk, obraz lub dane.

Co to jest QAM?

QAM to cyfrowa modulacja, która jednocześnie wykorzystuje amplitudę i fazę sygnału. Dzięki temu można przesyłać dużo więcej danych niż w prostszych metodach modulacji.

Co to jest OFDM i dlaczego jest ważne?

OFDM dzieli transmisję na wiele wąskich podnośnych, które pracują równolegle. Dzięki temu sygnał lepiej radzi sobie z odbiciami, zakłóceniami i wielodrogowością, co jest kluczowe dla Wi‑Fi, LTE, 5G i telewizji cyfrowej.

Dlaczego Wi‑Fi i 5G są takie szybkie?

Bo korzystają z zaawansowanych metod, takich jak QAM, OFDM i inteligentny podział zasobów radiowych. Pozwala to przesyłać wiele danych jednocześnie, przy dobrej odporności na zakłócenia.

Co to jest wielodrogowość sygnału?

Wielodrogowość oznacza, że ten sam sygnał dociera do odbiornika różnymi drogami, na przykład bezpośrednio i po odbiciu od budynku. To może powodować zakłócenia, ale nowoczesne systemy potrafią sobie z tym dobrze radzić.

Jak wiele urządzeń może korzystać z eteru jednocześnie?

Bardzo wiele, pod warunkiem że sieć dobrze podzieli zasoby. W praktyce robi się to przez podział czasu, częstotliwości, kodów albo kombinację tych metod.